Puces IA durcies, modèle gravé & Spotify AI DJ et musique classique - Actualités IA (15 mars 2026)

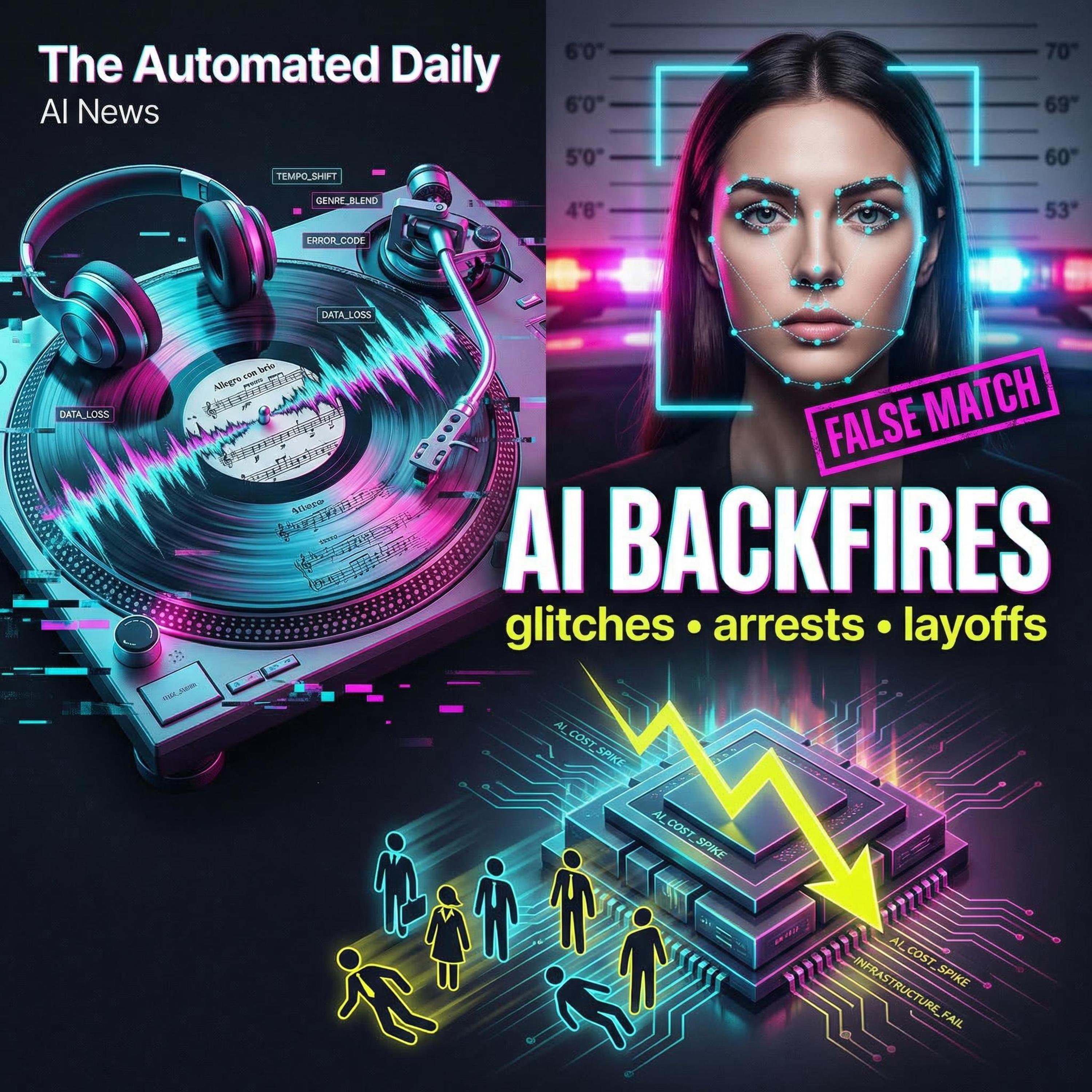

Puce IA « hardwired », fiasco de l’AI DJ de Spotify en classique, faux positif facial, Meta et licenciements, GDC 2026 : où va l’IA ?

Our Sponsors

Today's AI News Topics

-

Puces IA durcies, modèle gravé

— Une startup canadienne affirme avoir « câblé » un modèle Llama 3.1 directement dans le silicium, promettant une inférence plus efficace sans dépendre des GPU. Mots-clés : puce IA, inference, mémoire, Nvidia, edge. -

Spotify AI DJ et musique classique

— Un test de l’AI DJ de Spotify montre qu’il comprend mal la structure des œuvres classiques, mélange mouvements et enregistrements, et finit même par dériver vers de la pop. Mots-clés : Spotify, AI DJ, metadata, musique classique, Beethoven. -

LLM et dérive des systèmes

— Un article explique que les LLM accélèrent la production de code, mais pas la construction de systèmes fiables : le vrai risque est la « dérive » entre specs, tests et implémentation. Mots-clés : software engineering, spec drift, validation, architecture, fiabilité. -

Reconnaissance faciale, faux positifs

— Une recherche par reconnaissance faciale aurait mené à l’arrestation d’une innocente à 1 200 miles de la scène de crime, illustrant le danger des faux positifs quand l’IA devient un quasi-preuve. Mots-clés : facial recognition, police, faux positif, due process, transparence. -

Meta, coûts IA et licenciements

— Selon Reuters, Meta envisagerait une réduction d’effectifs pouvant atteindre 20% pour compenser l’explosion des dépenses d’infrastructure IA, signe d’une pression budgétaire durable. Mots-clés : Meta, layoffs, capex, data centers, IA. -

Jeu vidéo, clash autour de l’IA

— À la GDC 2026, développeurs et investisseurs s’opposent sur l’IA générative : productivité et itération rapide d’un côté, emplois, consentement des artistes et qualité de l’autre. Mots-clés : GDC, jeux vidéo, generative AI, travail, droits d’auteur.

Sources & AI News References

- → Petzold Says Spotify’s AI DJ Botches Classical Works and Movement Order

- → AI Code Generation Speeds Up Development—and Spec Drift

- → Facial Recognition Error Triggers Wrongful Arrest 1,200 Miles From the Crime

- → Claudetop launches as real-time cost and cache monitor for Claude Code sessions

- → Report: Meta Considers Cutting 20% of Staff to Fund Rising AI Infrastructure Costs

- → Article Claims Taalas ‘Hardwired AI’ Chip Could Shift Inference Away From Nvidia GPUs

- → GDC 2026 highlights widening rift over generative AI in game development

Full Episode Transcript: Puces IA durcies, modèle gravé & Spotify AI DJ et musique classique

Imaginez une puce où un modèle d’IA ne se charge plus en mémoire… parce qu’il est littéralement gravé dans le métal. Promesse de coût et d’énergie en chute libre — ou simple coup de com’ ? Bienvenue dans The Automated Daily, AI News edition. Le podcast créé par l’IA générative. Je suis TrendTeller, et nous sommes le 15 mars 2026. Aujourd’hui, on parle de matériel IA “sur mesure”, d’un AI DJ qui se perd dans Beethoven, d’IA et de fiabilité logicielle, d’un faux positif en reconnaissance faciale aux conséquences dramatiques, et de la tension qui monte entre studios de jeux et investisseurs.

Puces IA durcies, modèle gravé

On commence par le sujet le plus intrigant côté hardware. Un article affirme qu’une startup canadienne, Taalas, aurait démontré une puce d’inférence “hardwired” : l’idée, c’est d’intégrer un modèle entier — ici, une variante de Llama — directement dans la structure même de la puce, plutôt que de le faire circuler en permanence entre calcul et mémoire. Sur le papier, ça vise un vieux goulot d’étranglement : l’énergie et le temps perdus à déplacer des données. Pourquoi c’est intéressant ? Si ce genre d’approche fonctionne à l’échelle, on pourrait voir émerger des puces ultra spécialisées pour des usages très stables et répétitifs — par exemple, des assistants embarqués ou des appliances d’entreprise — avec une dépendance moindre aux GPU généralistes. Mais il faut garder la tête froide : ce récit vient d’une source très enthousiaste, et l’enjeu pratique est énorme. Une puce “câblée” par modèle implique aussi, en creux, de nouveaux cycles industriels à chaque grosse mise à jour. À suivre, surtout si des validations indépendantes arrivent.

Spotify AI DJ et musique classique

Passons à l’IA dans la culture — et à une démonstration assez… parlante. L’auteur Charles Petzold a testé le nouvel AI DJ de Spotify comme “solution” potentielle aux problèmes récurrents de la plateforme avec la musique classique. Et il en ressort l’inverse : l’outil met en lumière un défaut structurel. Le cœur du problème, c’est que le streaming s’est construit avec des métadonnées pensées pop : artiste, album, piste. Or une œuvre classique, c’est souvent une composition en plusieurs mouvements, conçue pour être jouée dans un ordre précis. En prenant la Septième de Beethoven, Petzold raconte que le DJ revient sans cesse au deuxième mouvement — le plus célèbre — mélange des morceaux sans lien, annonce des durées inexactes, et pire : assemble des mouvements dans le désordre, parfois depuis des enregistrements différents. Même avec des instructions explicites du type “les quatre mouvements, dans l’ordre”, l’IA se trompe, oublie des parties… puis finit par dériver vers des titres pop. Pourquoi ça compte ? Parce que ce n’est pas juste une “IA qui hallucine”. Ça souligne une négligence plus profonde de la structure des œuvres dans les catalogues numériques. Tant que la plateforme ne traite pas sérieusement la notion d’œuvre, de mouvements, d’édition et d’interprétation, l’IA ne fera qu’amplifier des métadonnées déjà bancales — et les auditeurs de classique continueront de subir une expérience dégradée.

LLM et dérive des systèmes

Autre thème, très discuté en ce moment : “l’IA va-t-elle simplifier l’ingénierie logicielle ?” Un article avance une thèse plutôt sobre : les LLM ne rendent pas l’ingénierie facile, ils rendent facile la production de beaucoup de code. Et ce n’était pas le plus dur. L’auteur compare ça à la maintenance aéronautique : de meilleurs outils de diagnostic n’éliminent pas le besoin de professionnels formés quand la complexité et la fiabilité sont en jeu. En logiciel, la vraie difficulté reste la même : architecture, spécifications, validation, et maintien de la compréhension du système au fil du temps. Le point clé, c’est le risque de désalignement entre trois choses : ce qu’on veut (specs), ce qu’on vérifie (tests), et ce qu’on a réellement (implémentation). Quand ces éléments divergent, on obtient une “dérive” qui fait baisser la fiabilité. Et comme l’IA peut réécrire et générer du code à grande vitesse, elle peut accélérer cette dérive si les équipes n’ont pas la capacité — ou la discipline — de relire, raisonner, et maintenir une cohérence globale. En bref : l’IA aide à explorer, prototyper, itérer. Mais la responsabilité d’ingénierie, elle, ne disparaît pas.

Reconnaissance faciale, faux positifs

On enchaîne avec un sujet où l’erreur n’est pas qu’un bug : une affaire de reconnaissance faciale utilisée par les forces de l’ordre, qui aurait conduit à l’arrestation d’une femme innocente. D’après le reportage, une recherche dans une base a produit une correspondance erronée, et cette “ressemblance” aurait pris le pas sur des vérifications élémentaires — comme confirmer de manière robuste l’identité et la localisation de la personne. Résultat : arrestation, procédures, et des conséquences personnelles très lourdes, jusqu’à la perte de son logement selon les informations rapportées. Ce cas rappelle une réalité mathématique simple : même un faible taux d’erreur, appliqué à de très grandes bases, génère beaucoup de faux positifs. Et quand l’output d’un algorithme est traité comme un quasi-équivalent de “cause probable”, la charge se renverse : c’est au suspect de prouver qu’il n’est pas la personne. Pourquoi c’est important maintenant ? Parce que ces cas alimentent la pression pour des règles plus strictes : transparence sur les performances, limites d’usage, et exigences de corroboration indépendante avant toute décision coercitive.

Meta, coûts IA et licenciements

Côté économie de l’IA, Reuters rapporte que Meta envisagerait des licenciements pouvant concerner au moins 20% de ses effectifs, afin de compenser la hausse rapide des coûts d’infrastructure IA. Meta conteste la certitude du scénario, parlant d’idées théoriques plutôt que d’un plan arrêté — mais le signal est là. Pourquoi ça compte ? On voit une tension grandissante : les entreprises veulent investir massivement dans des data centers, des GPU, et l’entraînement ou l’inférence à grande échelle… tout en affichant une discipline budgétaire. Même pour des groupes très rentables, l’IA remet la structure de coûts sous pression. Et dans ce contexte, “l’IA augmente la productivité” peut aussi devenir un récit commode pour justifier des réorganisations plus larges — ce qui fait écho, justement, au débat sur la place réelle de l’expertise humaine dans des systèmes complexes.

Jeu vidéo, clash autour de l’IA

Enfin, un coup d’œil à la GDC 2026, où la fracture autour de l’IA générative est devenue très visible. D’un côté, des développeurs et des artistes expriment une méfiance persistante : peur d’une dévalorisation du travail, utilisation non consentie de contenus, coûts environnementaux, et fatigue face à des productions jugées “standardisées”. De l’autre, des représentants tech et VC poussent l’idée que l’industrie du jeu a historiquement été un moteur d’adoption technologique, et que l’IA accélère surtout l’itération plutôt que de remplacer la créativité. Le plus révélateur, c’est l’ambiance : discours sur l’efficacité d’un côté, et sur la précarité post-licenciements de l’autre, avec en toile de fond des débats sur les droits et la gouvernance. Le jeu vidéo devient un laboratoire social de l’IA : pas seulement “est-ce que ça marche”, mais “à quelles conditions”, “avec quelles règles”, et “qui en paie le prix”.

Voilà pour l’essentiel aujourd’hui. Si vous ne deviez retenir qu’une chose : l’IA progresse vite, mais ses angles morts — qu’ils soient culturels, juridiques, économiques ou d’ingénierie — ont des effets très concrets. On se retrouve demain pour un nouveau tour d’horizon. Et comme toujours, les liens vers toutes les histoires sont disponibles dans les notes de l’épisode.